redditの『メタAIが132年間専門家を悩ませてきた数学の問題を解決: グローバル・リアプノフ関数の発見である。リアプノフ関数は、時間の経過に伴うシステムの安定性を分析するための重要なツールであり、有名な天体力学の3体問題のような動的システムの挙動を予測するのに役立つ。』より

翻訳元

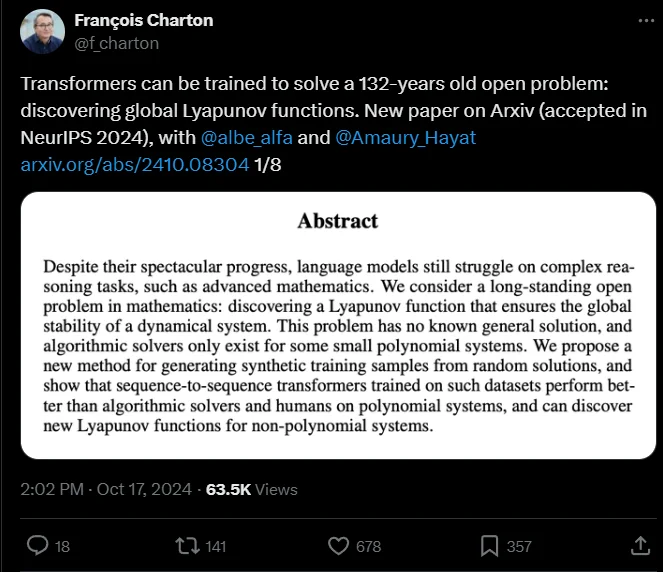

フランソワ・チャートン

@f_charton

トランスフォーマーは、132年間解かれていなかった問題、つまり大域的リアプノフ関数を発見する問題を解けるように訓練できるようになりました。NeurIPS 2024で採択された新しい論文(arXivに掲載)では、@albe_alfaと@Amaury_Hayatとの共同研究でこの成果を発表しています。

arxiv.org/abs/2410.08304 1/8

概要

言語モデルは目覚ましい進歩を遂げていますが、高度な数学のような複雑な推論タスクでは依然として苦戦しています。そこで、私たちは、動的システムのグローバルな安定性を保証するリアプノフ関数を見つけるという、長年の数学の未解決問題に取り組みました。この問題に対しては、一般解は知られておらず、アルゴリズムソルバーも一部の小規模な多項式系に対してしか存在しません。そこで、私たちは、ランダムな解から合成訓練サンプルを生成する新しい手法を提案し、このようなデータセットで訓練されたシーケンス・トゥ・シーケンス型のトランスフォーマーが、多項式系においてアルゴリズムソルバーや人間よりも優れた性能を示し、非多項式系に対して新しいリアプノフ関数を見つけることができることを示しました。

2024年10月17日午後2時02分

以下、海外の反応

- 名無しの外国人

AGIが十分に開発されれば、私たちはAGIをセットして科学をゼロからやり直すことができるだろう。

基本的な科学的仮定を検証し、新たな仮定を発見するためにAGIを使うことができるだろう。

その結果、まったく新しいものが生まれるかもしれない。私たちは未知の世界に向かっているのだ。 - 名無しの外国人

>>1

それだけでなく、彼らは私たちの過去の仕事をすべて分析し、私たちが何を見落としていたかを知ることができる。 - 名無しの外国人

しかし、それで何かが解決したのだろうか?一般的な解決策ではなく、より良い計算機を導き出しただけのように思える。論文には、解を見つける成功率は約10%12%と書かれているので、解は不正確なようだが、この分野の数学は私の知識レベルをはるかに超えている。 - 名無しの外国人

>>3

redditのタイトルよりも、twitterの「解くように訓練できる」というタイトルの方がより正確だ。しかし、このような深い複雑な数学的問題には、解けるか解けないかだけではありません。完全な解決に至るまでには、多くのブレークスルーがある。この論文で示されているのは、LLMがそのブレークスルーを加速するためにうまく使えるという概念実証である。 - 名無しの外国人

>>4

ありがとう!何が達成されたかを誇張することなく、その意味を理解するのに役立ついい説明だ。 - 名無しの外国人

まあ、明らかに解答は訓練データの中にあって、LLMはただの確率的オウムだからその出力を出しただけなんだよ。/s(皮肉)

『何を出力すべきか』を予測するために、内部の層は(物事に対する)モデル(理解)を発展させなければならない。時にはそのモデルが不完全なこともあるし、例やデータが増えると人間以上に良いモデルになることもある。 - 名無しの外国人

>>6

LLM(大規模言語モデル)ではないんだよ。このモデルの訓練データは、過去の問題の解答のみで構成されている。アルファフォールドやアルファ碁に近いものだね。 - 名無しの外国人

>>7

AIについて話すときに、多くの人がLLMや画像生成器のことを指しているのは、おそらく最も一般的な間違いです。

これらは、私たちが訓練するためのデータを簡単に手に入れることができたものなので、最初に作られたものです。ロボット工学がすぐに同じ技術的飛躍を遂げ、この論文が示すように、科学者たちはすでに機械学習を大規模に使用しています。

数十年間、人間が取り組んできたタンパク質フォールディング問題を数ヶ月で解決することは、非LLMトランスフォーマーモデルの素晴らしい例です。

このような発見は、すぐに当たり前になるでしょう。ソフトウェアフレームワークが成熟し、科学者やエンジニア(AIにCADプログラムを与えれば、同様の魔法が可能になる)がこれらのAIツールを使用するための技術を開発するにつれて、ますます速くなるでしょう。

人々は知性を持った機械に興奮していますが、それはAIの最終目標であり、私たちは基本的なツールの使い方を学び始めたばかりです。 - 名無しの外国人

これは頭でっかちのたわごとだ。マサチューセッツ工科大学(MIT)を卒業していない私たちのために、もう少し噛み砕いて説明してもらえないだろうか。 - 名無しの外国人

貧困問題は解決できるのか? - 名無しの外国人

どの言葉も理解できない…。でも、おめでとう! - 名無しの外国人

これはLLMとは関係なく、局所近傍類似性を使って高次関数を近似するトランスフォーマーの能力に関するものだ。トランスフォーマーは素晴らしい!LLMは中身のある誇大広告で、AGIは大規模なBSの誇大広告だ! 🙂。 - 名無しの外国人

>>12

LLMはトランスフォーマー・アーキテクチャーを使用しているが、違いはトレーニングデータである。 - 名無しの外国人

過去10年以上にわたって、グーグルはAIで1位、メタは2位だった。

現在もそれは変わらないと思う。 - 名無しの外国人

データサイエンティストが他の領域の問題を解決したと主張し、その結果をその領域のジャーナルではなくAIジャーナルで発表するのは大好きだ。 - 名無しの外国人

この言い回しにはいくつかの問題がある。

1.実際には、これは本当の意味でのLLM(大規模言語モデル)ではありません。このモデルは、同じ問題に対する解法のみに基づいて学習され、そこから新しい解法を生成する「内部アルゴリズム」のようなものを形成します。これは確かに興味深いですが、どちらかというとAlphaFoldやAlphaGoなどの「狭いAI」と比較する方が適切です。

2.また、「未解決問題を解決した」という表現も不適切です。というのも、この問題の本質は、ある動的システムが与えられたときに、特定の性質を持つ関数を構築することによって、そのシステムについての情報を得ることです。しかし、彼らは「すべての関数」を見つけたわけではありません。というのも、この質問に対する一般的な解法は存在しないからです。また、こうした関数を見つけるのは彼らが初めてでもなく、難しくないシステムであれば学生でも解けることがあります。

3.彼らのアルゴリズムは、修士1年生よりは優れていますが、現在の基準からすると少しお粗末な比較です。特にタイトルの設定を考えると、この程度では物足りません。 - 名無しの外国人

>>16

誰がLLMなんて言った?いつからAI=LLMになったんだ。私の1999年のビデオゲームは対戦相手をAIと呼んだ。一般用語だよ。 - 名無しの外国人

>>16

どこにLLMと書いてあるのですか? - 名無しの外国人

これは物理学の最も基本的な問題の一つではないか?

コメント